產品規劃|AI Eval

專案說明

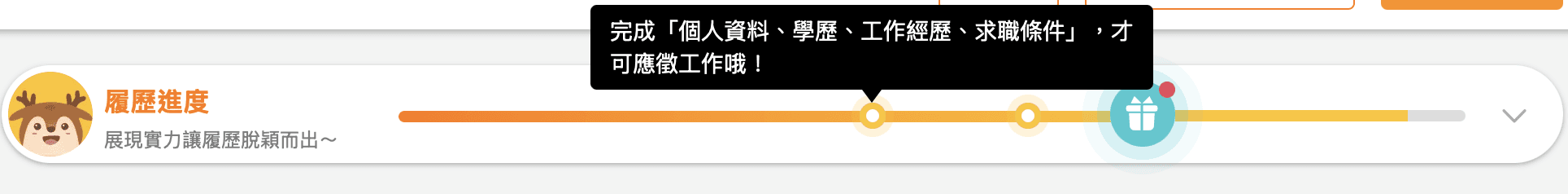

104 AI 履歷掃描匯入 (AI Resume Parser) 是一項旨在消除求職「冷啟動」門檻的體驗優化專案。

針對 104 網站強制要求求職者需填妥「個人資料、學歷、經歷、求職條件」四大區塊才能開始應徵的硬性規則,104 導入 PDF 解析技術,讓使用者上傳自備履歷即可自動解析並由 AI 完成 104 履歷表欄位填充( Slot Filling )。

雖然專案初期開發團隊已完成了「PDF 解析與 Slot Filling」的技術實作,但缺乏客觀的效能數據,無法評估實際上線後對使用者的真實影響。

因此,我在專案中的核心任務在於「建立驗收標準」與「確立上線 Benchmark」— 透過嚴謹的測試框架,將 AI 模型的表現量化,識別出產品的適用邊界(Boundary),作為產品是否 Launch (Go/No-Go) 的核心決策依據。

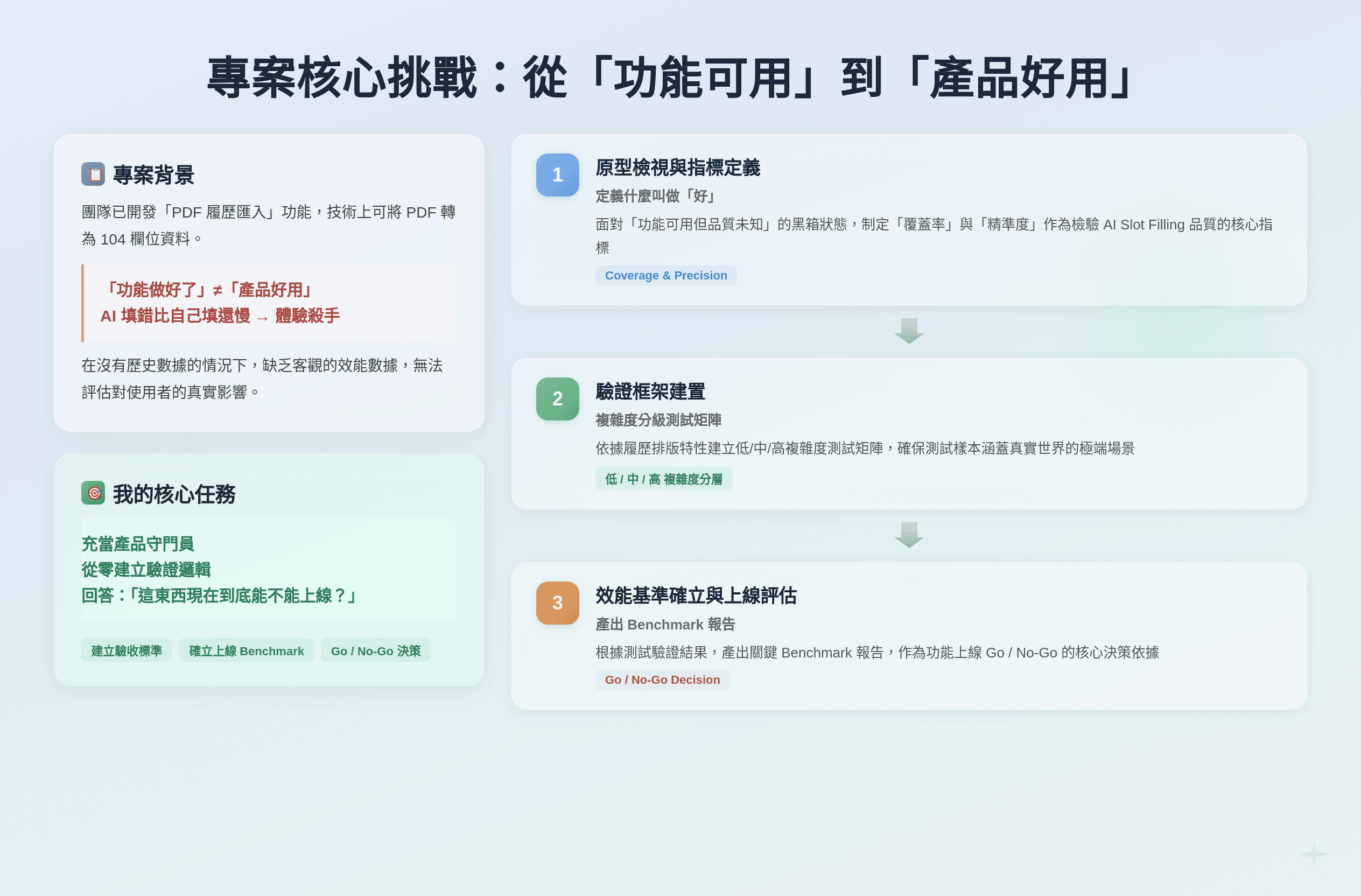

專案背景

為了降低求職門檻,團隊開發了「PDF 履歷匯入」功能,技術上已能做到將 PDF 轉為欄位資料。 但我面臨的挑戰是: 工程師說「功能做好了」,但這不代表「產品好用」。 如果我們在沒有驗證品質的情況下貿然上線,一旦 AI 填寫錯誤百出,使用者光是改錯的時間就比自己填還久,這功能反而會變成「體驗殺手」。

我的任務就是充當產品守門員,在沒有歷史數據的情況下,從零建立一套驗證邏輯,回答一個重要的問題:「這東西現在到底能不能上線?」

專案階段

階段一:原型檢視與指標定義

面對「功能可用但品質未知」的黑箱狀態,首要任務是定義什麼叫做「好」—— 制定「覆蓋率」與「精準度」作為檢驗 AI Slot Filling ( 是否合適轉譯為 104 履歷表欄位內容 )品質的核心指標

階段二:驗證框架建置

依據履歷排版特性建立「複雜度分級測試矩陣(低/中/高)」。確保測試樣本能涵蓋真實世界的極端場景

階段三:效能基準確立與上線評估

根據測試驗證結果,產出關鍵 Benchmark 報告。作為功能上線評估參考

專案過程

定義 AI 產品的「驗收標準」

在缺乏歷史標準的情況下,我制定了評估 AI Slot Filling 的兩大維度:

覆蓋率 ( Coverage ):PDF 裡有的資訊,AI 抓到了沒?(檢視 Recall,確保資訊不遺漏)

精準度 ( Precision ):AI 填進去的內容,是對的嗎?(檢視 Accuracy,確保使用者不用頻繁改錯)

設計「壓力測試」矩陣

為了抓出模型的死角,以分層驗證計畫,模擬真實用戶的各種履歷型態:

低複雜度:標準條列式(測試基本盤)

中複雜度:含表格/多欄位(測試結構理解)

高複雜度:設計型/圖文混排(測試模型極限)

執行「上線前」的基準測試

導入去識別化的真實履歷樣本進行系統性盲測。此階段的目的不僅是排除常規的系統錯誤,更是為了釐清 AI 模型在真實應用場景中的能力底線。透過第一手的量化數據,精準盤點出 AI 能穩定處理與無法勝任的排版類型。

解決方案

建構「複雜度分層驗證」架構

核心策略:拒絕平均數陷阱,還原真實場景的效能落差。

執行細節:將測試履歷樣本依據排版邏輯分為三層:低(標準條列)、中(表格/多欄)、高(設計型/非結構化)。並針對每一層級設定獨立的評測標準。

價值:透過複雜度分層,我們精準識別出產品在低中複雜度場景的高度可用性,以及確認了高複雜度場景下的精準度降低幅度。

確立「覆蓋率」&「精準度」衡量框架

核心策略:以「覆蓋率」與「精準度」定義 AI 的工作邊界。

執行細節:

覆蓋率:檢驗 AI 是否能妥善將履歷資訊填充入 104 履歷表對應欄位(召回導向)

精準度:檢驗 AI 填入 104 欄位資訊是否實質精確,不偏離原匯入履歷(精確導向)

價值:將主觀的「AI 好不好用」轉化為客觀的數據決策,並確立日後迭代優化的 Benchmark。

成果說明

量化產品現況,提供上線決策依據

透過驗證首次取得 AI 模型的真實效能數據。確認低、中複雜度履歷的「覆蓋率」與「準確率」皆達內部設定的商用標準,以此數據取代主觀臆測,作為功能全面上線的客觀支撐。

建立驅動後續迭代的 Benchmark

透過本次測試,確立了產品初期的分層效能基準線。未來模型更新與 Prompt 調整,皆可以此基準作為對比標準,確保優化成效可被量化,建立指標驅動的迭代模式。